DCIM et la gestion des infrastructures du datacenter

DCIM (Data Center Infrastructure Management) a pour finalité de modéliser l’ensemble des installations physiques d’un datacenter et de faire remonter les données comportementales, de manière à ce que les superviseurs puissent prendre des décisions cohérentes en cas de dysfonctionnement, voire confier ces décisions à un moteur d’IA. Mais aussi de leur donner une vue prospective de l’évolution de leur centre. On n’en est pas encore tout à fait là, mais l’horizon s’éclaircit et les ingrédients sont connus pour qu’il en soit ainsi.

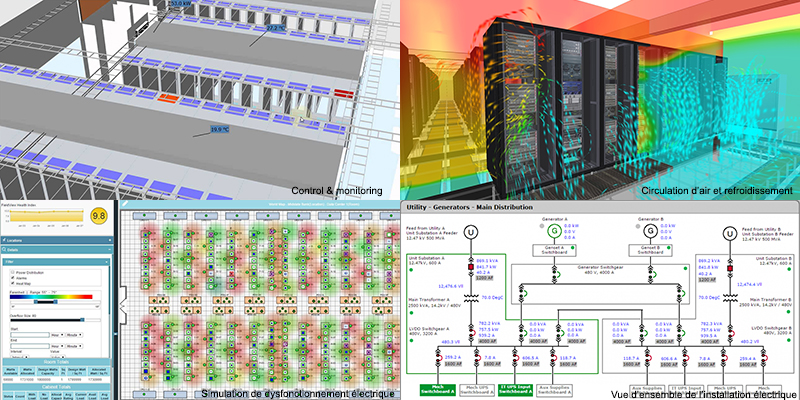

Les datacenters modernes, pour ceux qui n’ont pas encore migré sur le Cloud, ont besoin d’un suivi et d’une administration rigoureux. Ce n’est pas tout d’installer des racks et des baies de stockage, dont les fournisseurs vous diront qu’ils sont optimisés, ce qu’il faut c’est une vue d’ensemble, une perception globale des ressources. C’est ce que sont censés faire les logiciels DCIM (Data Center Infrastructure Management), qui nous fournissent depuis 2006 (plus ou moins bien) certaines informations nécessaires à la gestion des actifs, des serveurs, du stockage, des réseaux, du suivi de la consommation électrique et du respect des PUE (Power Usage Effectiveness), de la circulation d’air pour le refroidissement, de la gestion de l’espace, etc. Le DCIM étant sur le principe l’idéal pour optimiser les ressources physiques mises en œuvre et répondre aux problématiques d’évolution.

Le problème est que ces logiciels sont généralement insuffisants et n’ont pas convaincu les responsables de production, dont ils devraient normalement être les assistants privilégiés. Pour qui ils ont plutôt constitué une charge de travail supplémentaire et se sont traduits dans la pratique par de beaux dessins, distribués lors des réunions de « brainstorming » ou à l’occasion des visites clients, mais qui n’ont pas servi à grand-chose.

D’où un évident désintérêt de leur part.

On aurait pu enterrer définitivement la technologie, si une nouvelle génération d’outils n’était pas arrivée, plus moderne et réactive, qui peut-être pourrait faire changer la donne.

C’est ce que nous vous proposons de voir dans ce nouveau dossier. Histoire de décider si cela vaut la peine de se lancer aujourd’hui dans un projet DCIM, avec d’éventuelles extensions vers le DCSO (optimisation des services), voire le DMaaS, avec le portage de cette administration dans le Cloud. Ou s’il faut définitivement considérer que le DCIM, comme les CMDB d’ITIL, sont à ranger définitivement dans la catégorie des bonnes idées, mais impossible à mettre en œuvre.

Les fondements de DCIM

Comme l’explique fort bien Schneider Electric, l’un des principaux spécialistes de l’aménagement et du suivi comportemental des datacenters, les fonctionnalités d’un logiciel DCIM peuvent être regroupées en quatre grands pôles : le monitoring et l’automatisation des ressources physiques, la planification et l’implémentation, la collecte des données d’administration et les outils de restitution (dashboards). Parmi lesquels les deux premiers sont évidemment fondamentaux, les deux derniers ne faisant que collecter les données (ce qui n’est pas simple) et les restituer via des moyens de représentation adéquats.

Pour répondre aux besoins, les éditeurs de logiciels DCIM maintiennent le plus souvent une base de données de toutes les ressources susceptibles d’être installées dans une salle machine, avec leurs caractéristiques physiques, essentiellement les serveurs, les switchs de réseaux, les racks, les systèmes UPS (alimentation sans interruption), les PDU (Power Distribution Unit), les systèmes de refroidissement, etc. En tout, entre 3 et 10 000 références, selon les cas, voire plus.

L’objectif n’est cependant pas de faire du dessin, mais de nous permettre de répondre à des questions, aussi bien ponctuelles et courantes, sur un dysfonctionnement par exemple, que prévisionnelles, l’installation d’un nouveau serveur, la fragilité de l’alimentation électrique et la nécessité de la modifier, des simulations pour tester les mécanismes de secours, etc.

Sous-système de « monitoring et d’automatisation

Les deux modules les plus importants, sont ceux qui permettent de suivre le comportement des installations et d’anticiper sur les futures évolutions du datacenter.

Selon Schneider, le premier de ces modules, le monitoring et l’automatisation regroupe deux grandes familles de fonctions, la capture des données et leur traitement.

Les données capturées sont celles des installations électriques, mais aussi celles de l’environnement HAVC (Heat, Air Conditioning, Ventilation). Il arrivera que certains équipements fassent remonter les informations via des protocoles plus ou moins propriétaires : BACnet, par exemple, un protocole de l’organisation ASHRAE (Association de constructeurs et d’utilisateurs dans le domaine du chauffage, de la ventilation et de la climatisation), devenu un standard international ANSI et ISO, mais aussi LONworks, orienté vers la gestion des bâtiments, voire Modbus, un protocole créé en 1979 par Modicon, pour les réseaux d’automates programmables.

Certains DCIM vont englober dans ce sous-système des fonctions sécuritaires, d’authentification par exemple, ce qui ne nous sembles pas être pertinent, l’important étant que les mécanismes AHA (Autorisations, Habilitations, Accès) et DCIM puissent s’interfacer sans difficultés. Chacun ayant ses spécificités, il est réducteur de vouloir les regrouper.

La deuxième famille d’outils, constitue le cœur fonctionnel de DCIM, la partie traitement, avec des modules de visualisation des données, des outils pour gérer les configurations et des moyens d’analyse et de « reporting », voire de plus en plus d’IA.

Sous-système de planification et d’implémentation

Il s’agit là d’un aspect fondamental de DCIM, qui justifie à lui seul les efforts qu’il faudra consentir pour se mettre à niveau.

Il comporte diverses fonctions censées simplifier les changements d’architectures, la planification des modifications et leur mise en œuvre concrète :

- Facility Asset Management : déploiement des ressources (les actifs)

- Facility Capacity Management : aide aux changements, en termes mécaniques et électriques, une fonction importante pour anticiper sur les risques potentiels qu’ils peuvent induire et y remédier sans crainte de franchir les limites imposées.

La mise en œuvre DCIM

Les logiciels DCIM ont surtout pour objet d’élaborer la perception physique des installations. Le plus souvent, il faut passer par un utilitaire de dessin propriétaire, en important des objets prédéfinis, selon différents formats. Parfois avec Visio de Microsoft, qui n’est pourtant pas ce qu’il y a de plus interactif et moderne, mais aussi avec Autocad, voire importer des images PDF. Il faudra simplement être vigilant sur la diversité des formats d’entrée, qui pourraient constituer un obstacle, vis-à-vis du DCIM retenu.

Dans tous les cas, il y aura un gros travail de dessin à effectuer, car nous n’en sommes pas encore (malheureusement) à demander aux outils DCIM d’effectuer cette tâche ingrate à notre place, simplement en lançant des sondes dans l’installation et en détectant les équipements installés. Ce serait évidemment l’idéal, comme on l’avait imaginé pour les bases CMDB d’ITIL, mais ce que l’on n’a jamais réussi à mettre en place.

Le véritable problème, en fait, n’est pas là.

Il se situe dans l’interaction qu’il faut construire entre ce « dessin » et la réalité physique des installations, avec les deux fonctions qui justifient la présence d’une solution DCIM : réagir aux évènements et anticiper sur les besoins du datacenter.

Si on n’est pas capable de la mettre en œuvre de manière satisfaisante, il est inutile de persévérer. A moins de vouloir perdre son temps.

L’évolution du marché

Ce n’est certes pas un raz de marée, mais il existe quand même un courant intéressant en faveur de DCIM. Un certain optimisme partagé par la plupart des consultants qui sont d’accord pour estimer la progression du marché à 20 % entre 2017 et 2024 (CAGR). Global Market Insights prévoit même que le volume total d’affaires DCIM devrait atteindre 3 milliards $ en 2024. Ce qui n’est pas énorme si on le compare au prix payé par Microsoft pour racheter GitHub (7,4 milliards $) ou encore aux 67 milliards $ payés par Dell pour racheter EMC. On n’est évidemment pas dans la même mouvance.

Il existe aujourd’hui une douzaine d’acteurs sur ce marché spécifique DCIM, plus ou moins performants, parmi lesquels Schneider Electric, Siemens, Nlyte, Intel, etc. Tous ne sont pas au même niveau fonctionnel et certains ne proposent qu’une perception limitée de l’infrastructure IT, les équipements de ventilation par exemple ou les serveurs.

Nul doute que dans le futur ce sont les solutions les plus universelles qui l’emporteront, qui constitueront l’interface unique entre les administrateurs et les ressources installées.

Si le mode « best of breed » pouvait se comprendre, il induit de tels efforts d’interfaçage et de consolidation qu’il s’élimine de lui-même.

Après une période de découragement, les DCIM pourraient revenir au goût du jour, car ils vont bénéficier du déferlement des capteurs et des technologies associées.

Il ne fait aucun doute que les futurs DCIM seront ce que l’on appelle déjà des jumeaux de surveillance, à savoir basés sur des capteurs implantés dans les équipements physiques, susceptibles de faire remonter, en temps réel, les informations comportementales vers une installation virtuelle, le DCIM moderne. Sur lequel les responsables de production pourront appliquer des modèles de simulation et se rendre compte concrètement comment ils réagissent au fameux « what-if ».

De sorte que l’on peut imaginer ce que sera à moyen terme une architecture DCIM. Destinée à de gros clients essentiellement, locaux et Cloud. Qui aura globalement deux grandes caractéristiques.

Tout d’abord des standards clairs sur le suivi des ressources (assets tracking), par grandes familles : traitement, stockage, refroidissement, alimentation électrique. Les futurs matériels seront dotés de capteurs, qui émettront de manière paramétrable des informations sur leur comportement. Les précédents dispositifs, RFID par exemple, vont disparaître, au profit de ces capteurs intelligents.

Des logiciels DCIM ensuite, qui seront écrits non pas pour des équipements référencés dans une base de données, qui de toute façon, n’est jamais à jour, mais en fonction de messages standardisés, dans lesquels ils trouveront toutes les informations dont ils auront besoin : l’identité de l’équipement, ses caractéristiques, les données de comportement instantané, etc. Des logiciels DCIM qui seront donc génériques et s’appliqueront à une couche intermédiaire standardisée entre les équipements réels, les capteurs et les serveurs sur lesquels ils vont s’exécuter. Un peu comme une application Android mobile, qui ne se préoccupe pas de la manière dont les smartphones et tablettes sont implémentés.

Etant entendu que cette couche applicative bénéficiera de l’apports des moteurs d’IA, qui prendront en compte les paramètres d’une situation donnée, de manière à prendre les décisions pertinentes pour la traiter : dysfonctionnements, montée des températures, panne de climatisation, dégradation de la qualité du courant électrique.

Pour parvenir à cette organisation, il faudra qu’un forum se mette en place, qui regroupera les parties prenantes DCIM et « fabriquera » le standard d’ « asset tracking ». Cela demandera forcément du temps, tant les intérêts divergent entre les fabricants et prestataires concernés.

Mais on peut toujours rêver…

Il est probable, enfin, que les futurs DCIM seront hébergés dans le Cloud, en mode SaaS, ce que l’on appelle déjà les DMaaS (Datacenter Management as a Service). Deux prestataires étant déjà présents sur le créneau : Schneider Electric avec le service EcoStruxureIT et Eaton, qui bénéficient d’une large expérience, acquise depuis plusieurs années sur des installations locales.

La seule interrogation porte sur l’intérêt d’un tel forum de standardisation, lié à l’importance du marché. Si 70 % des datacenters migrent vers le Cloud avant 20 ans, le fait de disposer d’un DCIM standardisé, ne présentera plus le même intérêt, l’administration des ressources physiques étant placée sous la responsabilité des Clouds.

Pour ce qui est des entreprises moyennes ou petites, qui n’auront pas besoin de la réactivité temps réel d’un DCIM moderne, nous pensons qu’à l’inverse, elles continueront soit à les ignorer, soit se contenteront de les traiter avec Excel et quelques beaux camemberts. Autrement dit, sans grand intérêt.

Le souvenir des CMDB d’ITIL doit en tout cas, nous inciter à la plus grande prudence, car rien ne dit que les DCIM sortiront de l’anonymat, dans lequel ils se trouvent aujourd’hui.

Les critères sont évalués de 1 à 5

- Marché

- Présence réelle sur le marché.

- Usage

- Intérêt potentiel, hors considérations commerciales

- Standards

- Niveau de standardisation du sujet

- Coût

- Intérêt potentiel, hors considérations commerciales

- Futur

- Niveau de crédibilité prévisible

- Maturité

- Niveau de maturité atteint actuellement

Faut-il s’expatrier : les faiblesses de l’oncle Sam

Le mystère des bases de données vectorielles

Module Architectures applicatives et développement d’APPLICATIONS