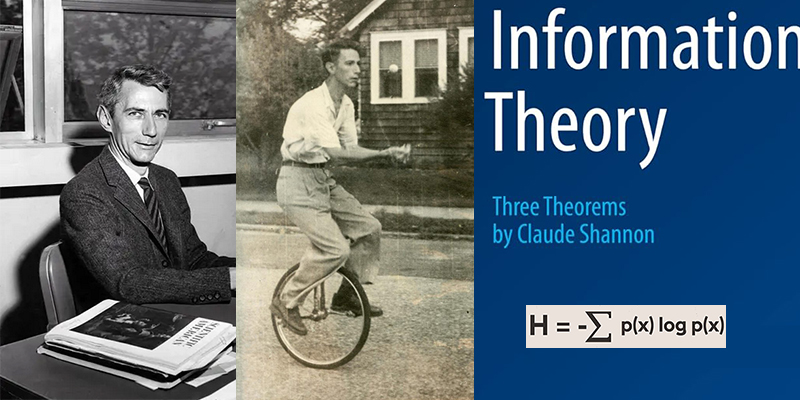

Claude Shannon, le père de la théorie de l’information

Présenté comme l’inventeur de l’ordinateur moderne, ce qu’il n’est pas, l’américain Claude Elwood Shannon est celui de la théorie de l’information, dans laquelle il a su combiner les contraintes de la représentation binaire avec les nécessités des télécommunications numériques. Il est l’un des principaux personnages de notre spécialité. L’équivalent d’un Newton.

Claude Shannon est un personnage bicéphale, à la fois mathématicien et électronicien, ce qui lui vient de sa formation pendant laquelle il a été amené à fréquenter les 2 disciplines, conclues par une thèse de doctorat en mathématiques et un master en électronique, ce dernier portant sur la conception des circuits électroniques.

De ce fait, ses contributions ont été à la fois nombreuses et fondamentales.

Son document de master "A Symbolic Analysis of Relay and Switching Circuits" sera publié dans le célèbre “Journal of the American Institute of Electrical Engineer” et constituera une base fondamentale pour la représentation des circuits électriques à l’aide de fonctions booléennes, ce qu’il a été le premier à suggérer.

C’est à lui que l’on doit le fait de représenter un flot de données à transmettre par des bits, la notion de chiffre binaire qu’il a inventé, numériques par conséquent, par opposition à l’analogique qui était en vigueur auparavant. Ce qu’il a formalisé dans un "papier" resté célèbre : "A Mathematical Theory of Communication", la Bible que tout le monde devrait avoir lue.

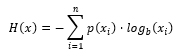

C’est à lui aussi que l’on doit la notion d’entropie appliquée aux systèmes numériques. Car si le concept existait déjà depuis le XIXème siècle, proposé par le physicien allemand Rudolf Clausius, c’est Claude Shannon qui l’appliquera aux systèmes numériques dans les années 50.

Cette entropie est sans doute l’un des concepts les plus difficiles à cerner du monde du TI. On peut la résumer (pardon aux puristes…) comme une mesure de l’incertitude, le refus du "chaos" et du désordre, à savoir par exemple, le nombre minimum de bits nécessaires pour qu’une source de données puisse émettre sans perte d’information. L’analyse étant différente selon que les données sont compressées ou non.

Si on se contente de coder en binaire des données en dessous de ce seuil, leur communication pourra très bien se passer, mais aussi se dégrader. D’où une incertitude de comportement, que Shannon a quantifié par une formule célèbre : Où X est une variable aléatoire qui prend les valeurs x1 , x2,…..xn avec des probabilité p(x1), p(x2)…p(xn) et b la base du logarithme.

Où X est une variable aléatoire qui prend les valeurs x1 , x2,…..xn avec des probabilité p(x1), p(x2)…p(xn) et b la base du logarithme.

En 1948, Shannon va se focaliser sur la meilleure manière de coder l’information et en déduira un certain nombre de concepts essentiels : la théorie de l’échantillonnage, les techniques de correction d’erreurs et surtout les algorithmes de compression sans erreurs. Autrement dit de compression des données sans pertes, avec possibilité de retour à l’’original.

On peut affirmer sans se tromper qu’aucun informaticien n’a pu exercer son métier sans appliquer les idées de Shannon. Et ce qui était vrai hier, l’est encore aujourd’hui.

On attribue aussi à Claude Shannon un rôle moteur dans le domaine de l’Intelligence Artificielle. Mais nous serons de ce point de vue moins enthousiaste, car s’il a effectivement participé à la fameuse conférence de Dartmouth College de 1956, avec notamment Marvin Minsky et John McCarthy, il ne jouera pas un rôle de premier plan dans cette discipline, hormis le fait qu’il ait, par exemple, construit le premier ordinateur doté d’un algorithme capable de jouer aux échecs.

Une triste fin

Professionnellement, hormis sa participation à l’effort de guerre américain, Claude Shannon n’aura connu que deux grands employeurs, les Bell Labs où il passera 30 ans de 1941 à 1971 et le MIT où il enseignera pendant 20 ans, de 1958 à 1978. Il n’avait donc pas l’âme vagabonde et n’a pas cherché à créer des compagnies qui auraient pu bénéficier de l’apport de ses "formidables" intuitions et réalisations.

Ce n’est pas pour autant qu’il n’avait pas le sens de l’humour, bien au contraire. Et les employés des Bell Labs ont eu souvent l’occasion de le voir déambuler dans les couloirs de l’entreprise, chevauchant un monocycle et dans le même temps jonglant avec des balles.

Claude Shannon sera de tous les honneurs, mille fois mérités : la Médaille Nationale de la Science des mains du président Johnson en 1966, entre autres. Bien entendu, les Universités les plus prestigieuses lui auront fait les yeux doux : Yale, Michigan (où il a fait une partie de ses études) et surtout Princeton, où il aura eu l’occasion de rencontrer Albert Einstein, mais avec lequel il n’entretiendra pas de liens particuliers, Einstein étant physicien et Shannon mathématicien, le père (contesté) de la relativité n’étant pas réputé pour être un mathématicien de génie.

Claude Shannon n’aura malheureusement pas une fin digne de lui. Il contactera la maladie d’Elzeimer et finira ses jours le 24 février 2001 au "Courtyard Nursing Care Center" de Medford, dans le Massachussets. Très triste fin pour l’un des plus grands génies qu’auront produit les mathématiques, de la lignée des Turing, Newton et Pascal. Nul doute qu’aujourd’hui, dans son coin de Paradis, il ne cherche à prouver sa théorie de l’entropie avec Newton, le but du jeu devant être forcément de déterminer le nombre de balles maximum à adresser à Newton, sans que celui-ci ne se prenne les pieds dans le tapis en les retournant. Interprétation évidemment toute personnelle de l’entropie…