Deep et dark Web, quand le rare côtoie le pire

Module RÉSEAUX opérateurs, téléphonie et InternetIl se dit qu'’il n'y a que 10 % des informations, sites, documents et médias, qui sont accessibles par un moteur classique, Google ou autre. Le reste, 90 %, se trouvent dans les couches profondes du "deep" et du "dark" web. Auxquels on accède par des moyens détournés…

A la louche on dira que le "deep web" est une sorte de gros marché où l'on peut trouver de tout et surtout ce que l'on ne trouve pas ailleurs, des bases de données, des documents réservés à une population privée, des produits avec les clés pour les installer, etc. Alors que le "dark", qui porte bien son nom, est le recueil de tout ce que les êtres humains sont capables de produire : des drogues, des fichiers volés en vente libre et toutes sortes de produits interdits, jusqu'à des organes vivants pour des candidats aux transplantations.

Si l'on veut, à nos risques et périls, naviguer dans ces strates glauques, on ne pourra pas utiliser notre navigateur habituel, ni notre moteur de recherche favori, car les sites hébergés ne sont pas indexés.

On se servira, par exemple, du navigateur TOR et des moteurs spécialisés qui recensent les sites deep et dark : The Hidden Web, TorLinks, Not Evil ou Candle, par exemple.

Attention cependant, la garantie de préservation de notre identité par TOR n’est pas certaine et des organismes compétents et bien équipés, sauront la retrouver, de même que notre adresse IP. Le mieux est alors de passer par un VPN.

C'est dans ce monde que nous vous convions. Pour un spécialiste de la sécurité, c'est une mine d'or, où il va trouver les techniques d’attaques les plus pertinentes, les forums les mieux informés, histoire de pouvoir ensuite nous en protéger. Comme la peur n'éloigne pas le danger, les entreprises doivent disposer d'une telle compétence interne. C''est ce que nous faisons… parfois en nous bouchant le nez !

Les bases et arbres de connaissances

L’efficacité d’une entreprise et celle d’un algorithme d’IA dépend pour l’essentiel des données sur lesquelles ils peuvent s’appuyer. Il suffit donc de transférer ces données dans une base de données dédiée. C’est vrai, sauf que c’est tout sauf simple.

Ouvrons les portes de la recherche TI

L’Intelligence Artificielle n’est pas une fin en soi, même si elle occupe une grande partie de nos préoccupations. La recherche dans le TI a depuis longtemps anticipé sur le futur et dégagé des voies qui continueront de nous surprendre.

Les datacenters dans le désert ou la banquise

Depuis toujours, d’immenses territoires sont réputés incompatibles avec les pratiques de notre société. Cela va changer et les datacenters seront les premiers à s’installer dans les déserts et zones froides de la planète. C’est déjà le cas.

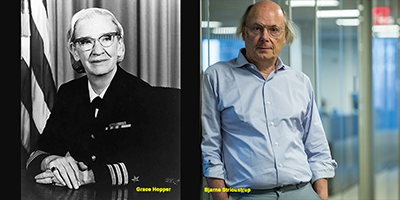

Grace Hopper et Bjarne Stroustrup, une même flamme à 30 ans d’intervalle

Grace Hopper et Bjarne Stroustrup sont 2 personnages incontournables, sans qui le développement n’aurait jamais été ce qu’il est devenu.

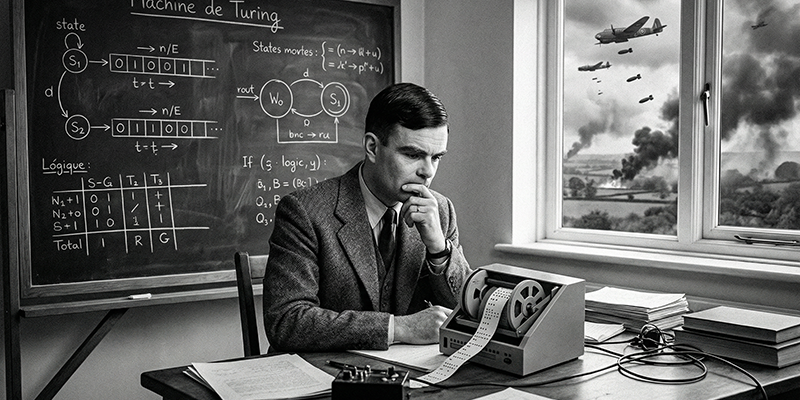

La machine de Turing, une référence théorique

La machine de Turing est un concept d’ordinateur, imaginé en 1936 par Alan Turing, l’extraordinaire mathématicien britannique, pour donner corps au concept d’algorithme et de procédure mécanique.

L’état de l’art de la vision par ordinateur

La vision artificielle ou reconnaissance d’images par ordinateur est l’un des domaines qui a le plus progressé ces dernières années. La "faute" encore à l’Intelligence Artificielle, dont la quasi-totalité des applications sont demandeuses. Rien d’étonnant à ce que cela bouge autant.

Les religions et l’Intelligence Artificielle

Nous sommes en train de vivre une transformation à nulle autre pareille, qui touche tous les domaines. Les religions n’y échappent pas. On peut en parler.

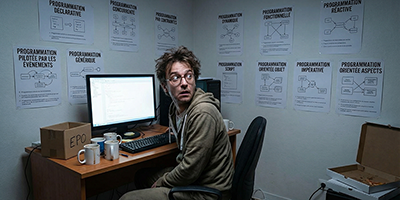

Le labyrinthe des modes de programmation

Les développeurs font face à une multiplicité de formes de programmation, liées aux architectures applicatives. Parmi lesquelles ils doivent faire un choix, éventuellement se former. Ce qui n’est pas facile. Du seul codage impératif d’autrefois, ils sont passés à un véritable labyrinthe où il est très facile de se perdre.

Pour nos abonnés

- Suivez LeMarson en direct

- Accédez à des centaines de dossiers et d'articles

- Visionnez des dizaines d'heures de formations vidéos

- Téléchargez le Livre des tendances de l'année